Este texto fue encargado por la publicación Arts Of The Working Class a partir de mis reflexiones iniciales en Instagram; el texto puede leerse impreso en la edición #36 del magazine, dedicado al topic "Experience".

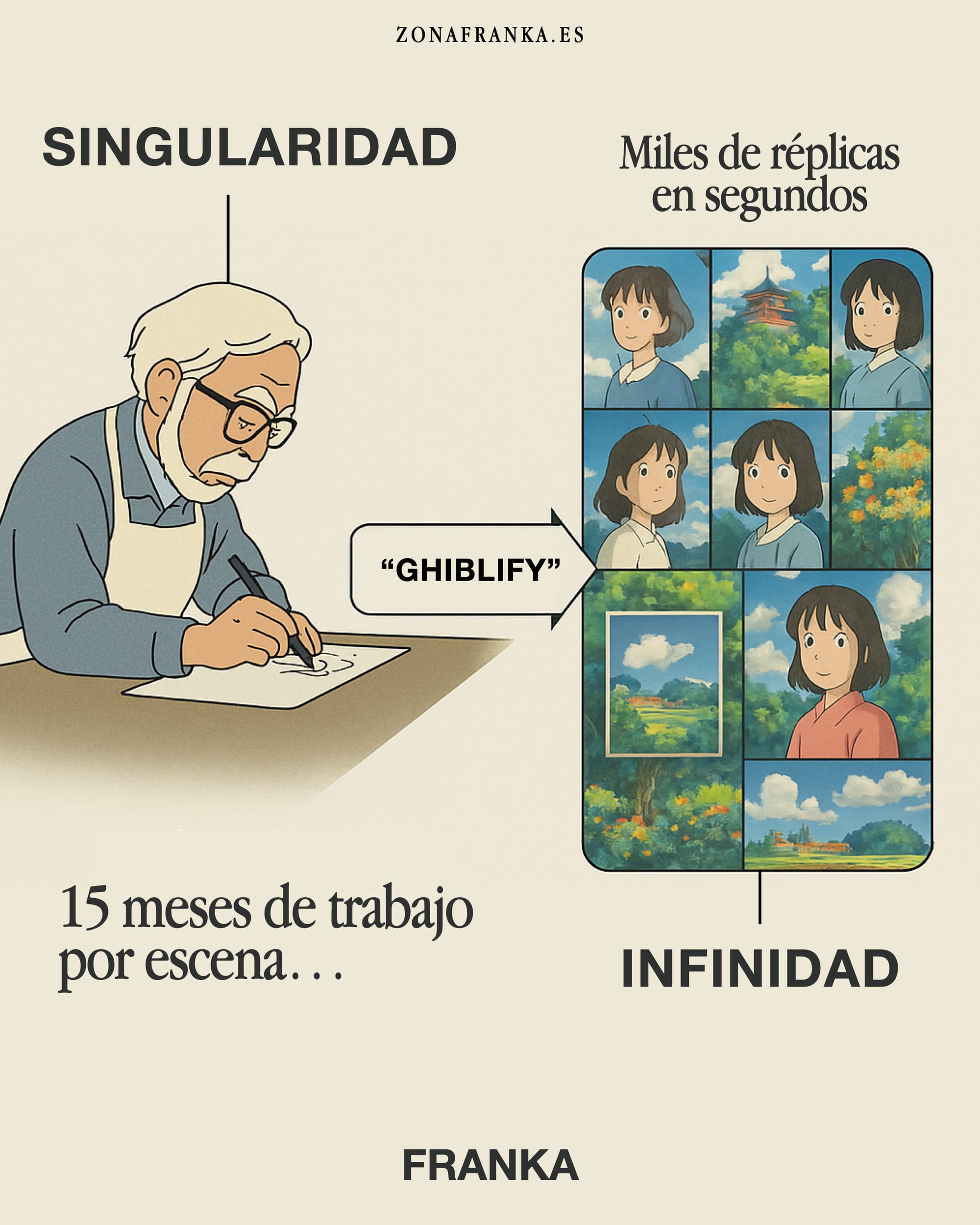

Entre 2023 y 2025, el internet ha experimentado una transición estética y estructural silenciosa pero de gran alcance que ha influido en la producción de significado en la cultura visual. Un ejemplo paradigmático de esta transición es el reciente fenómeno de la ghiblificación: la posibilidad de transformar cualquier fotografía personal —mediante inteligencia artificial— en una imagen con una estética inspirada en el universo visual del estudio japonés de animación Studio Ghibli, fundado en 1985 por los directores Hayao Miyazaki e Isao Takahata, junto con el productor Toshio Suzuki.

Lo que comenzó como un juego creativo promovido por OpenAI —a través de ChatGPT y su nuevo modelo de generación de imágenes— derivó rápidamente en un nuevo ejemplo del colapso semántico: la proliferación masiva de un estilo hasta vaciarlo de toda resonancia.

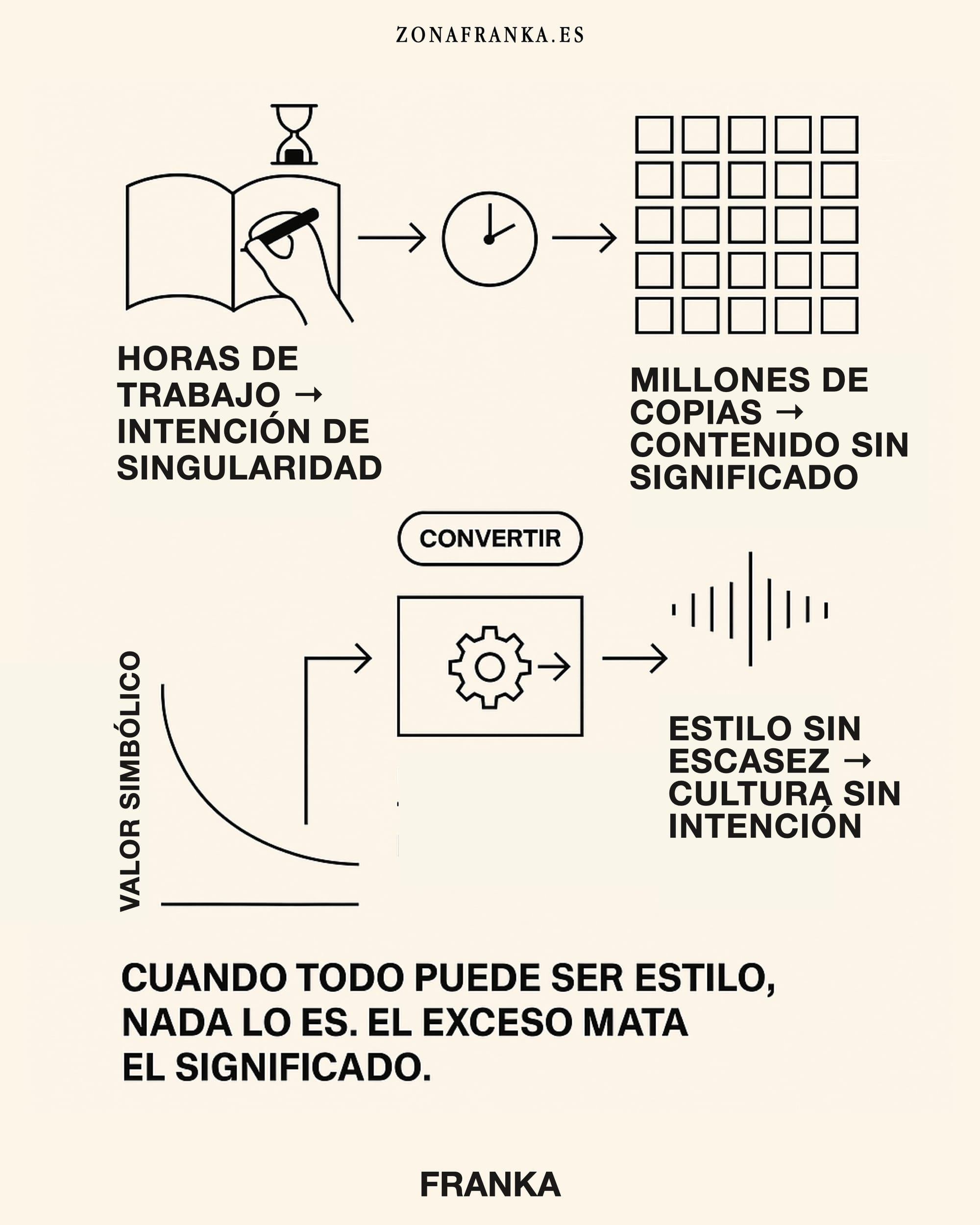

Voces como la de Erik Hoel —neurocientífico, novelista y autor del blog The Intrinsic Perspective— defienden que parte de esta crisis se debe a la falta de profundidad del contenido en internet desde mucho antes de la aparición de las IA generativas. En su texto Welcome to the Semantic Apocalypse Hoel describe este proceso como una saturación cultural inducida por la sobreabundancia de contenidos generados por IA que provoca una forma de saturación colectiva. Como cuando una palabra se repite tantas veces que deja de tener sentido, la reiteración de estéticas sin contexto erosiona su potencia simbólica. La IA no sustituye al arte humano por su calidad o profundidad, sino por su volumen, velocidad y disponibilidad. No necesita ser mejor, sólo necesita ser más. Y eso basta para desactivar el impacto cultural del original.

Este fenómeno se alinea irónicamente con una táctica ya conocida en el ámbito de la comunicación política actual: la estrategia atribuida a Steve Bannon de flood the zone with shit, y reflexionada por el periodista Charlie Warzel como una combinación "potente" de "creatividad e insolencia". Dicha estrategia fue también formulada por el programador italiano Alberto Brandolini como bullshit asymmetry principle o la "ley Brandolini" —la cantidad de energía necesaria para refutar una tontería es un orden de magnitud mayor a la necesaria para producirla—, y sirve para explicar por qué internet está tan lleno de contenidos mediocres: es más fácil replicar que contradecir, más fácil simular que investigar.

Saturamos el espacio informativo hasta hacer imposible la distinción entre verdad y falsedad. Lo que era una táctica de desinformación se ha convertido, a través de la IA, en nuestro propio mecanismo de reproducibilidad adoptada. La generación masiva de contenido se convierte en una forma de neutralización simbólica. No hay censura: sólo hay ruido.

De este contexto surge el término AI slop, que designa el contenido generado por IA que prolifera(rá) en plataformas digitales como basurero visual: estéticamente atractivo, pero vacío de tensión interna o conflicto real. Un relleno basura infinito. Este slop algorítmico no busca significar, sino ocupar espacio. No propone preguntas, sino soluciones visuales predigeridas. Se trata de una estética de superficie, producida a gran escala y destinada a la obsolescencia instantánea. Como sugiere K Allado-McDowell en su ensayo Am I Slop?, publicado en el blog The Long Now, el slop "está hecho para gustar al mayor número de personas posible, pero no satisface a nadie".

Lo relevante no es tanto que estas herramientas existan, sino que han modificado de forma estructural nuestra relación con la imagen, el texto y la subjetividad. La IA no sólo produce contenido: produce marcos de percepción. Según Allado-McDowell, hemos entrado en la era de los medios neuronales, donde ya no somos usuarios sino posiciones estadísticas embebidas en un modelo. Nuestras decisiones, preferencias e identidades son embebidas como vectores de comportamiento, optimizados para predecir y replicar. Es una nueva forma de subjetividad: no narrativa, sino probabilística. El "yo" se convierte en data.

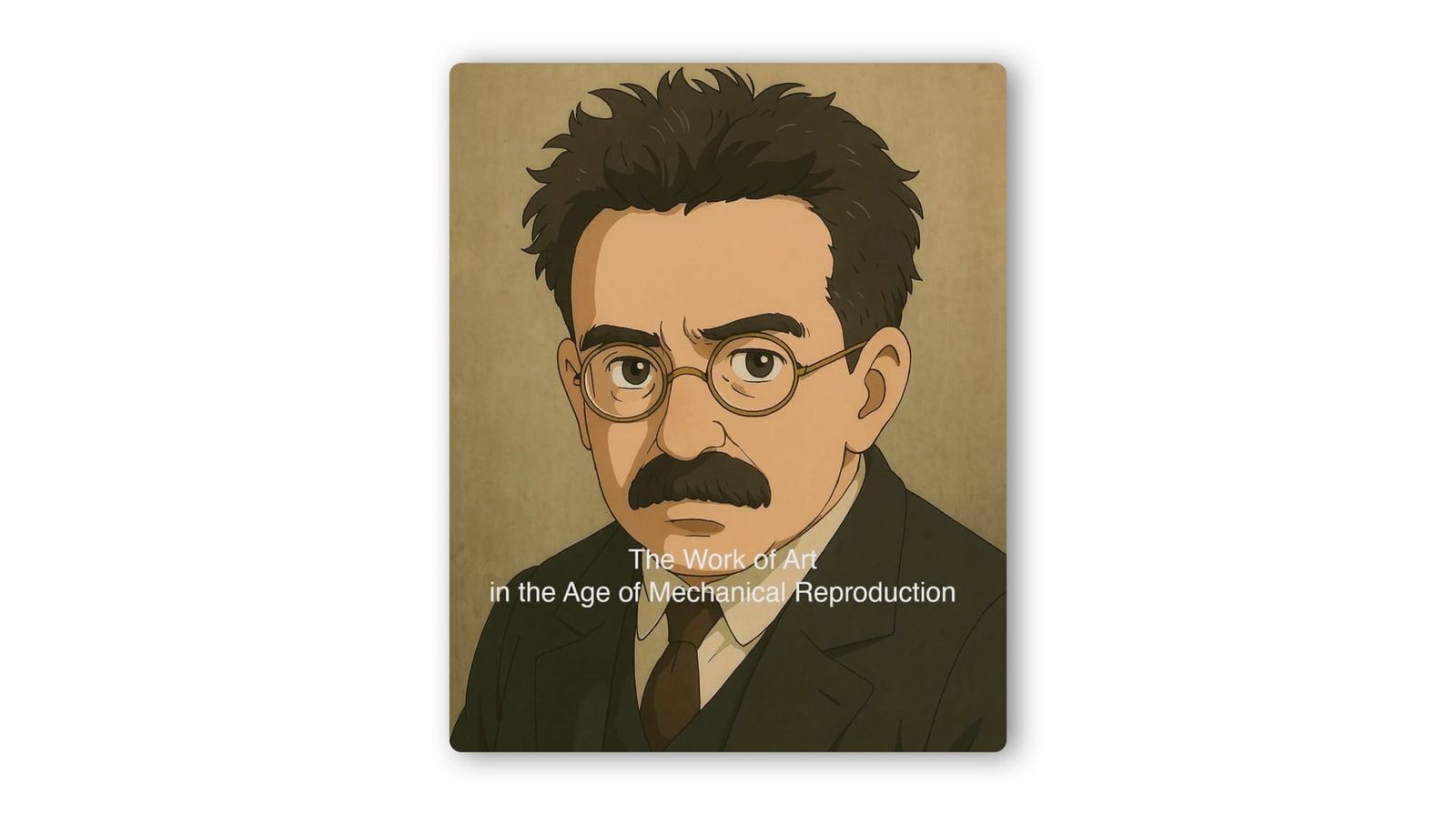

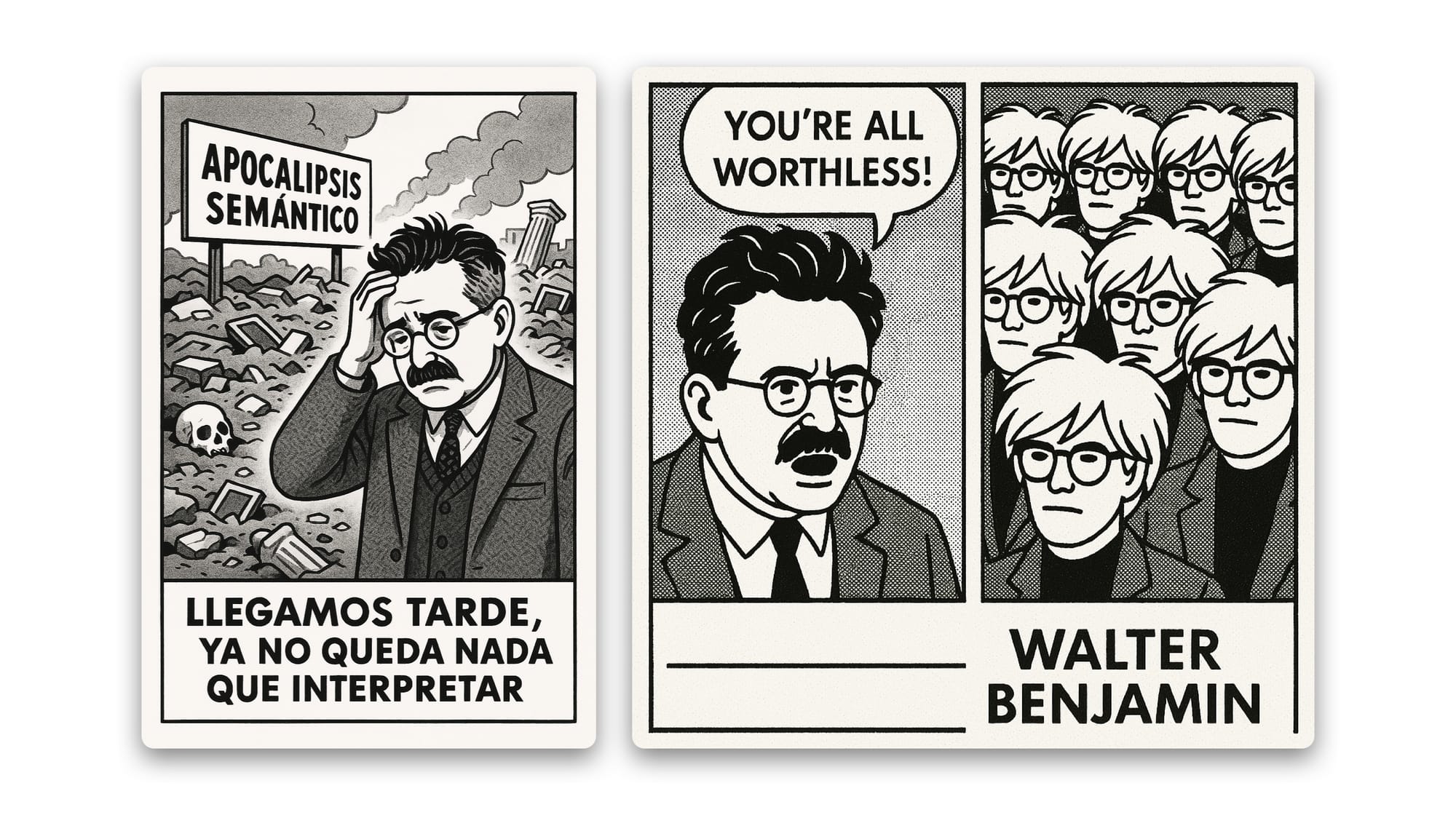

En este marco, la IA no democratiza el acceso al arte, sino que lo convierte en un flujo estético continuo, disponible a demanda, tal y como Walter Benjamin expresó en La Obra de Arte en La Epoca de su Reproducibilidad Técnica 90 años atrás. La escasez simbólica desaparece, y con ella, la posibilidad de interpretar. El arte deja de ser una experiencia para convertirse en una opción visual. Ya no se contempla: se selecciona. La obra ya no circula entre multitudes: flota entre fantasmas.

Todo apunta a que el valor ya no residirá en la originalidad formal, sino en la capacidad de establecer relaciones significativas. La escasez no será técnica, sino afectiva. La atención se orientará hacia lo que aún pueda generar vínculo. Lo ambiguo, lo incierto y lo no replicable se vuelven esenciales, porque son lo único que la IA no puede automatizar. El gesto irrepetible, la interacción humana, la comunidad indocumentada como los últimos campos de resistencia.

En lugar de preguntarnos cómo contener el ruido, busquemos recuperar el valor de lo que queremos compartir, conmover, transformar nosotros mismos. Defendamos la experiencia como territorio irreductible. Tal vez así (re)aprendamos a diferenciar entre lo que decora y lo que todavía significa.